温馨提示:这篇文章已超过466天没有更新,请注意相关的内容是否还可用!

摘要:AI视频领域推出Stable Video Diffusion技术,实现视频稳定性扩散,提升用户体验。本文附有相关体验地址供读者尝试。这一技术将为视频制作和分享带来革新,让视频更加流畅自然。

介绍

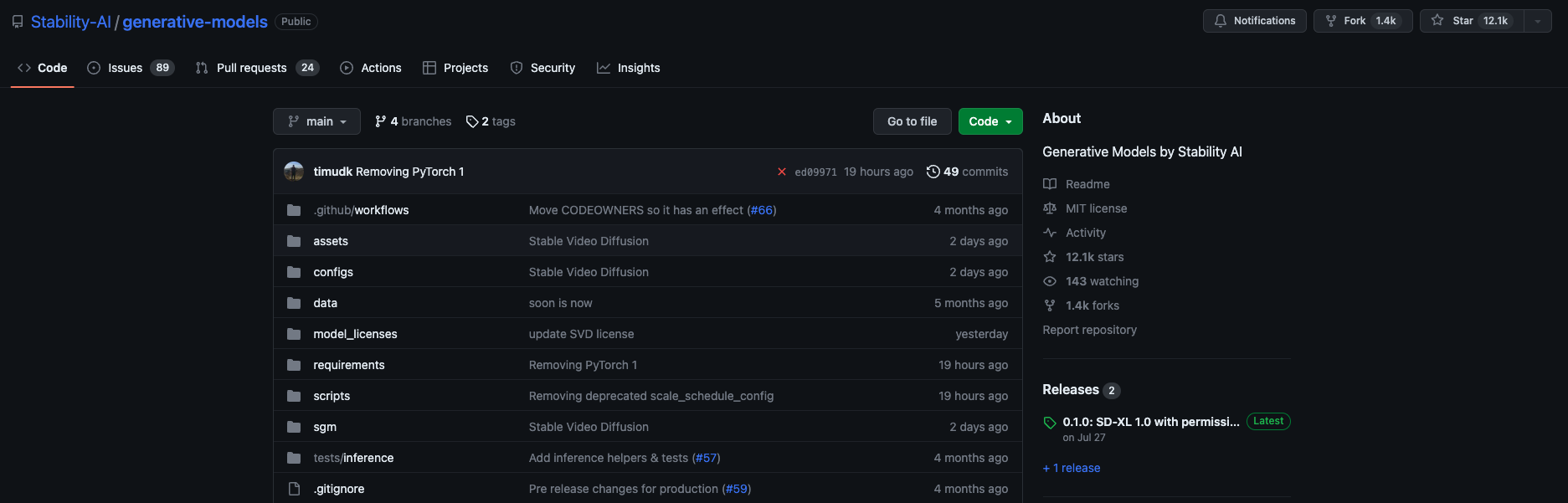

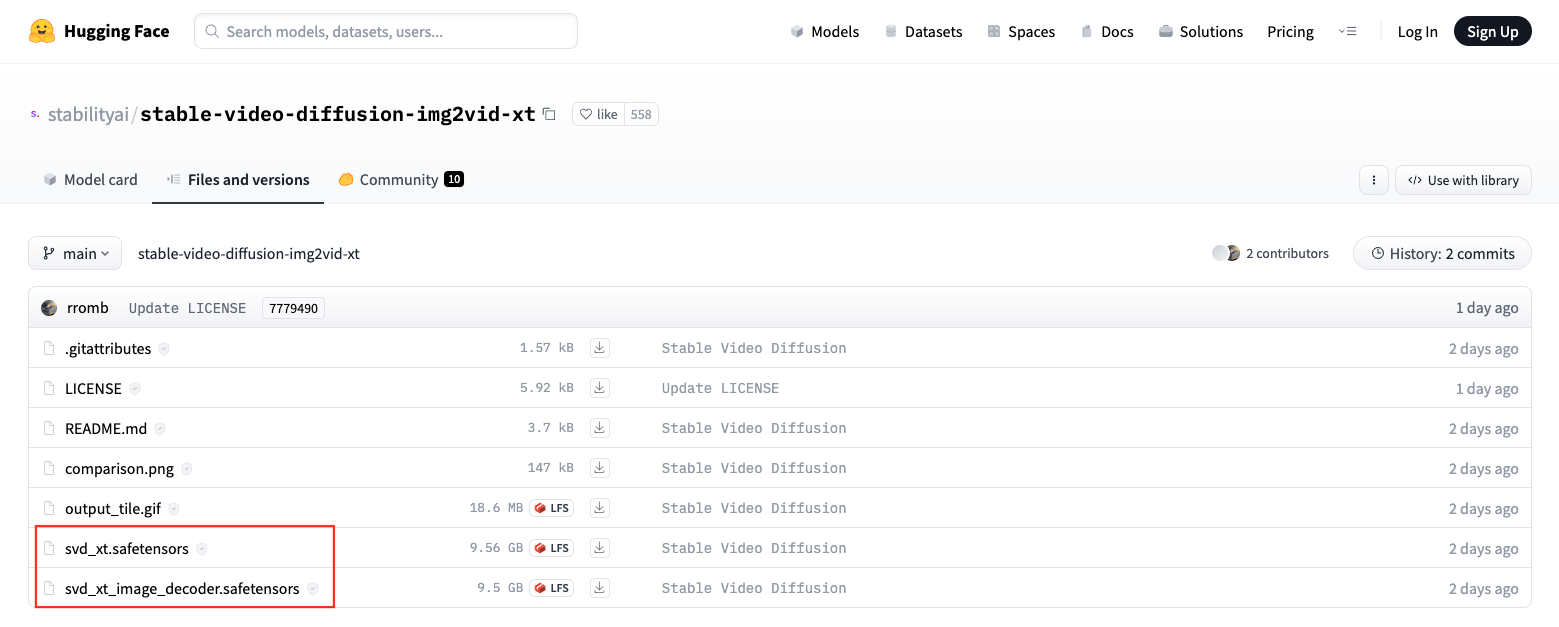

2023年11月21日,Stability AI推出了基于图像模型的Stable Diffusion的生成式视频基础模型——Stable Video Diffusion,这是Stability AI的首个视频生成模型,Stability AI已在GitHub上开源了Stable Video Diffusion的代码,在Hugging Face平台上也可以找到模型本地运行所需的权重。

GitHub链接:[https://github.com/Stability-AI/generative-models](https://github.com/Stability-AI/generative-models)

Hugging Face链接:[https://huggingface.co/stabilityai/stable-video-diffusion-img2vid-xt](https://huggingface.co/stabilityai/stable-%E8%A1%A8%E9%A2%91%E6%9C%AF%E6%B3%A8%E6%BA%90img2vid-xt)

Stable Video Diffusion模型能够轻松适应各种下游任务,并计划在此基础上建立一系列模型,类似于围绕Stable Diffusion建立一个生态系统,在外部评估中,Stable Video Diffusion发布的SVD和SVD-XT模型在用户偏好研究中已经超越了Runway和Pika Labs。

局限性

尽管Stable Video Diffusion展现出强大的潜力,但仍需注意以下几点局限性:

1、该模型尚不适用于实际或商业应用,Stability AI强调,尽管模型在生成视频方面取得了进展,但仍需要进一步的研究和改进,以满足实际应用的复杂需求。

2、网页体验目前尚未向所有用户开放,感兴趣的用户可以在[https://stability.ai/contact上申请候补资格,](https://stability.ai/contact%E4%B8%8A%E7%94%B3%E8%AF%B7%E5%A4%87%E7%AE%BE%E8%B5%84%E6%A0%BC%E3%80%82)

3、关于在Hugging Face上的Stable Video Diffusion模型(特别是img2vid-xt版本),该模型主要用于研究目的,生成的视频长度相对较短,尽管这一模型在视频生成方面表现出色,但在生成更长时间的视频方面仍有局限,对于视频的质量和连贯性等方面也存在一定的挑战,仍需要进一步的研究和改进。

随着技术的不断进步和研究的深入,我们期待Stable Video Diffusion在未来能够克服这些局限性,为视频生成领域带来更多的创新和突破。

还没有评论,来说两句吧...