温馨提示:这篇文章已超过449天没有更新,请注意相关的内容是否还可用!

摘要:NumPy库与PyTorch库都是科学计算中常用的库,它们有异同点。NumPy作为基础的数值计算库,提供了多维数组对象和各种派生对象,适用于大量数值数据的处理和分析。而PyTorch是一个开源的深度学习框架,提供了张量计算和神经网络构建等功能,适用于机器学习和深度学习领域。两者的主要区别在于,NumPy更注重数值计算,而PyTorch更专注于深度学习。它们也有相似之处,比如都支持矩阵运算和优化等。

目录

单位的创建和操作

1、创建

NumPy:使用 np.array() 创建数组。

PyTorch:使用 torch.tensor() 创建张量,这里的张量与NumPy的数组概念相似。

2、形状变换

NumPy:使用 arr.reshape() 变换数组形状。

PyTorch:使用 tensor.view() 或 tensor.reshape() 变换张量形状。

数学和统计操作

1、矩阵乘法

NumPy:使用 np.dot() 或 @ 运算符进行矩阵乘法。

PyTorch:使用 torch.matmul() 或 @ 运算符进行矩阵乘法。

2、广播

广播机制是在不同形状的数组(或张量)之间进行数学运算时的一种技术,它能自动扩展数组的维度,使其符合运算要求,从而避免了明确复制数据的需要,这种机制可以显著减少内存使用,并提高计算效率,NumPy和PyTorch都支持广播机制,允许形状不完全相同的数组进行数学操作,具体细节可以参考关于NumPy库的介绍。

3、统计计算

NumPy:使用 arr.mean(), arr.sum(), np.median(arr) 等方法进行统计计算。

PyTorch:使用 tensor.mean(), tensor.sum(), torch.median(tensor) 等方法进行统计计算。

GPU支持

NumPy:主要在CPU上运行,没有内建的GPU支持。

PyTorch:可以直接在GPU上运行计算,通过.to('cuda')方法将张量移动到GPU。

GPU(图形处理单元)是一种专门设计用来处理图形和视频渲染的计算设备,由于其高度并行的结构,GPU现在广泛用于各种高性能计算任务,特别是在数据科学、机器学习和深度学习领域。

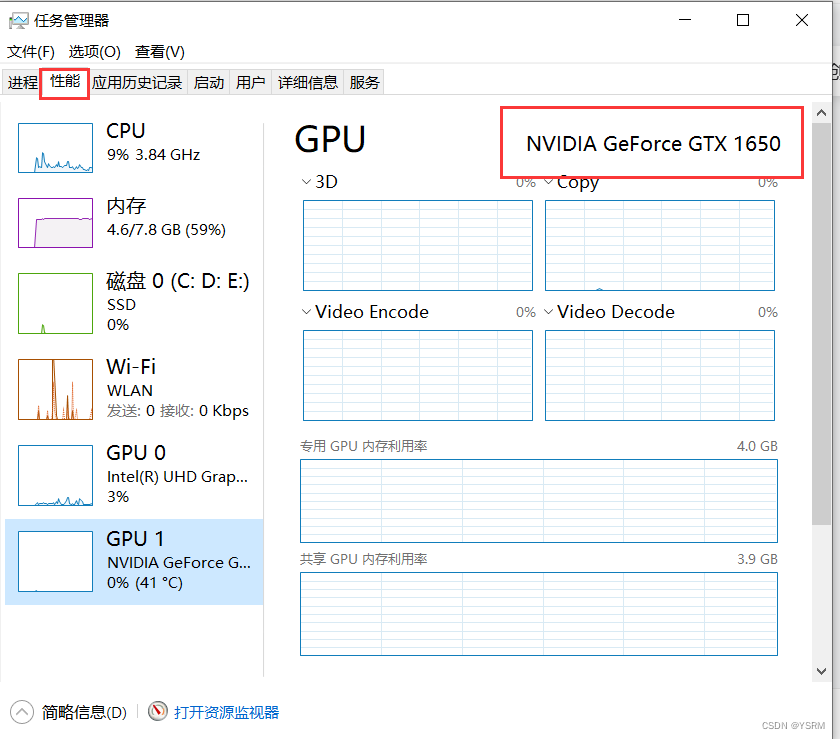

如何查看自己的GPU?打开任务管理器,调到性能这一栏查看,可以通过nvidia-smi命令查看GPU是否在工作,前提是需要安装CUDA和nvidia驱动。

在深度学习中的作用

NumPy:不支持自动梯度计算和反向传播,通常需要手动实现或使用其他库。

PyTorch:通过Autograd系统自动管理梯度计算和反向传播,使用tensor.backward()自动计算梯度。

应用范围

NumPy:广泛应用于科学计算领域,如物理模拟、统计分析、图像处理等。

PyTorch:专为深度学习设计,广泛用于构建和训练各种类型的神经网络。

虽然NumPy和PyTorch在基本操作上非常相似,但PyTorch通过支持动态计算图、GPU加速以及集成深度学习特有的功能(如自动梯度计算),为深度学习提供了更加专业和高效的工具,而NumPy则是一个更通用的科学计算库,广泛应用于广泛的科学研究领域。

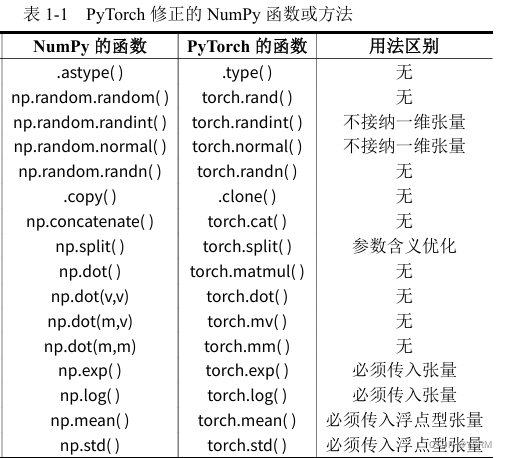

以下是PyTorch库对NumPy库中若干方法的修正对比图(具体图片内容您提供,这里无法生成)。

还没有评论,来说两句吧...