温馨提示:这篇文章已超过401天没有更新,请注意相关的内容是否还可用!

摘要:,,Spark SQL执行引擎是Apache Spark中用于处理结构化数据的组件,其原理基于分布式计算框架Spark的核心机制。它通过优化SQL查询并执行计划,在集群上并行处理数据。配置Spark SQL执行引擎时,需关注资源分配、内存管理、执行器数量及内存等关键参数。合理配置能提高查询性能并优化资源利用。

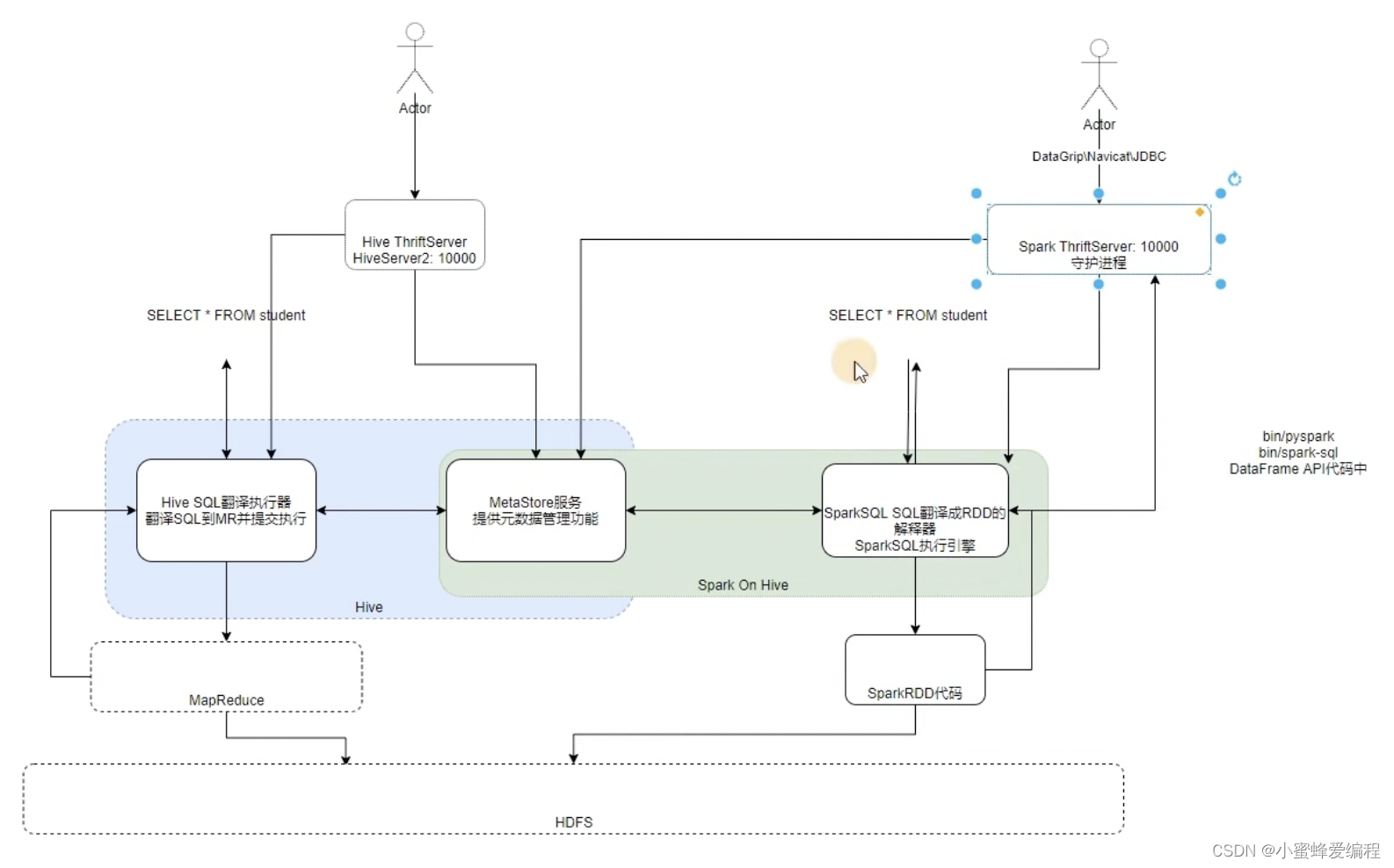

如果我们想要给上层开发人员配置好一个统一的sql开发界面,让他们统一通过sql开发即可,可通过spark中的thriftserver服务实现,与hive中的thriftserver类似,配置好该服务后,上层通过db client或者代码中通过jdbc连接即可直接使用sql操作,

该服务会去请求metastore服务得到元数据后,再将sql语句及元数据给到执行引擎,转换成rdd代码执行。

一个配置案例如下:

1.确保已经配置好了Spark On Hive

2.启动ThriftServerl即可

#直接在root账户下启动即可

$SPARK HOME/sbin/start-thriftserver.sh

–hiveconf hive.server2.thrift.port=10000

–hiveconf hive.server2.thrift.bind.host=nodel

–master local[2]

#master选择local,每一条sql都是local进程执行

#master选择yarn,每一条sql都是在YARN集群中执行

文章版权声明:除非注明,否则均为VPS857原创文章,转载或复制请以超链接形式并注明出处。

还没有评论,来说两句吧...