温馨提示:这篇文章已超过394天没有更新,请注意相关的内容是否还可用!

摘要:在Unity游戏引擎中,通过特定技术实现文字转语音功能,并且使转换后的语音与人物模型的口型动作同步。这一技术涉及语音合成和人物模型动画的协同工作,确保语音输出与角色口型运动保持一致,提升游戏体验的真实感和沉浸感。这种技术可广泛应用于角色扮演游戏、交互式故事体验等领域。

文章目录

插件介绍

今天我们将通过Unity实现文字转语音,并且使人物模型的口型与语音同步,为此,我们需要使用两个插件:语音口型同步“OVRLipSync”和文字转语音“RTVoice”。

RTVoice:

离线文字转语音功能,支持所有构建平台,包括Windows、macOS、Android和iOS,将文本实时转换为语音,无需配音演员即可在测试阶段进行语音生成,提供多种声音选项,如按姓名、文化和性别筛选,并支持语速、音调和音量的微调,还提供了最新的单词、唇形和音素数据,生成的音频可存储为文件在Unity中反复使用。

OVRLipSync:

一种语音驱动人脸动画的技术,主要通过识别语音中的音素来驱动人物模型的口型同步,它可以从真人配音或文本转语音(TTS)技术中获取语音序列,识别出的音素会与人物模型中的动画或面部参数匹配,从而实现口型同步,现有的唇同步技术大多使用MPEG-4视频编码标准中的人脸动画参数。

导入RTVoice

1、插件传送门

RTVoice插件的获取和使用方法。

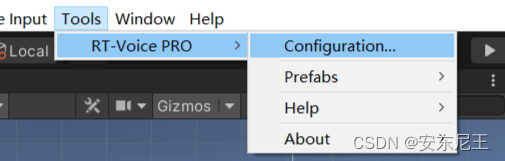

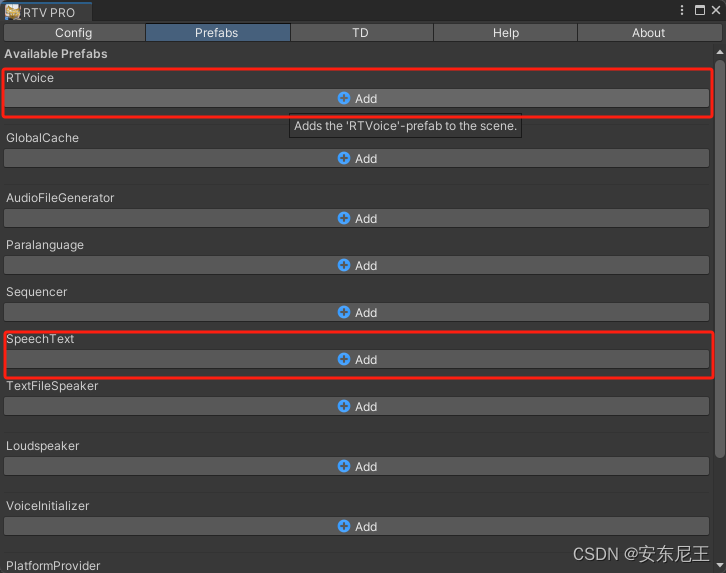

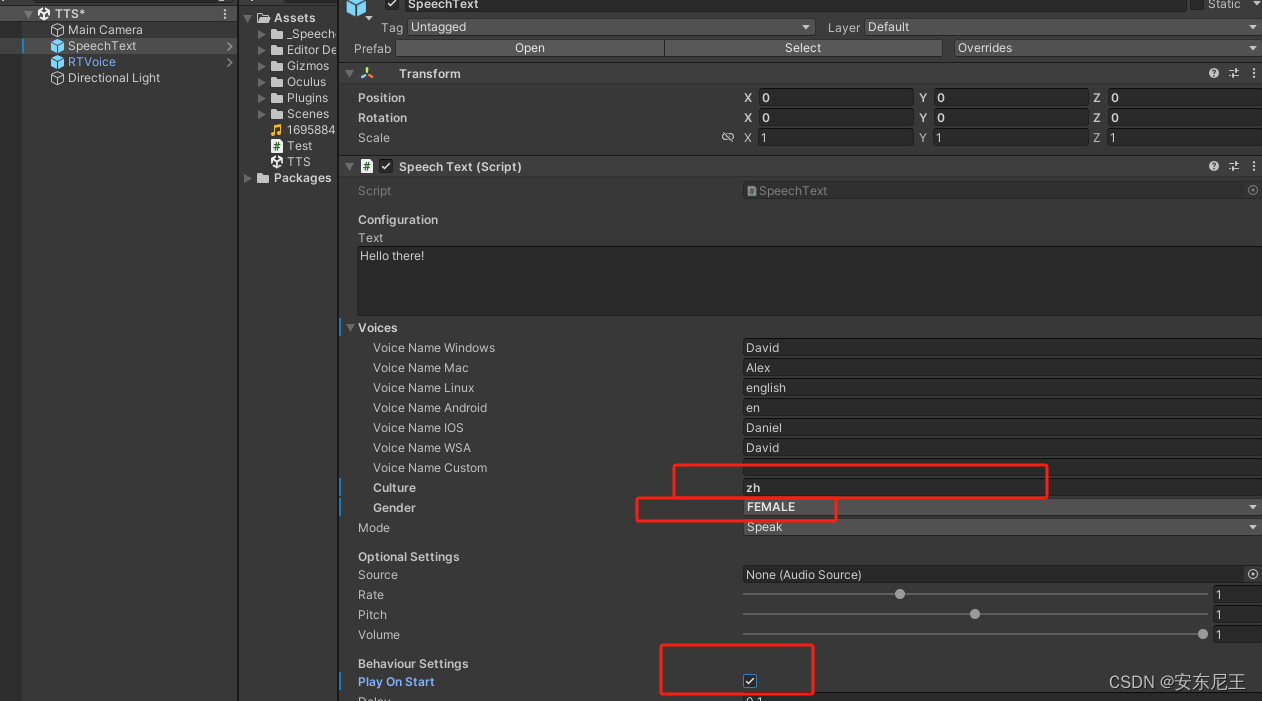

2、组件配置

详细介绍如何配置RTVoice插件和SpeechText组件,包括添加RTVoice和SpeechText组件,修改语言、男女生选择等设置,以及如何在程序启动时运行语音的方法,还提供了如何触发播放文本语音的示例代码。

导入OVRLipSync

1、插件传送门

介绍如何获取和使用OVRLipSync插件。

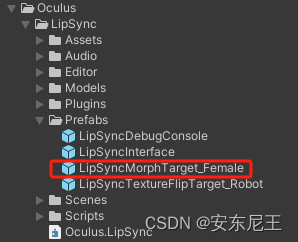

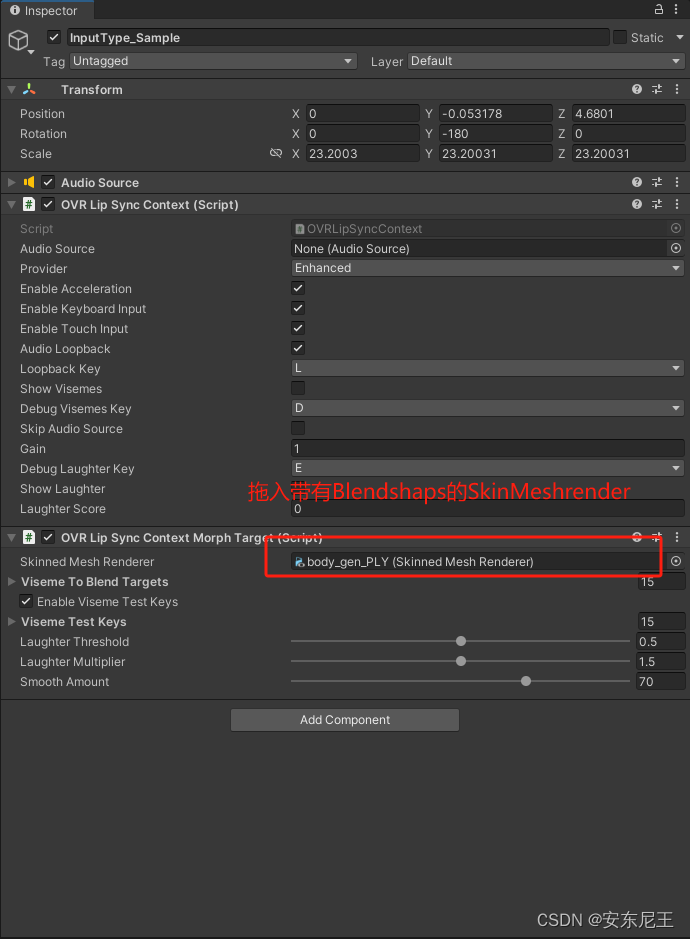

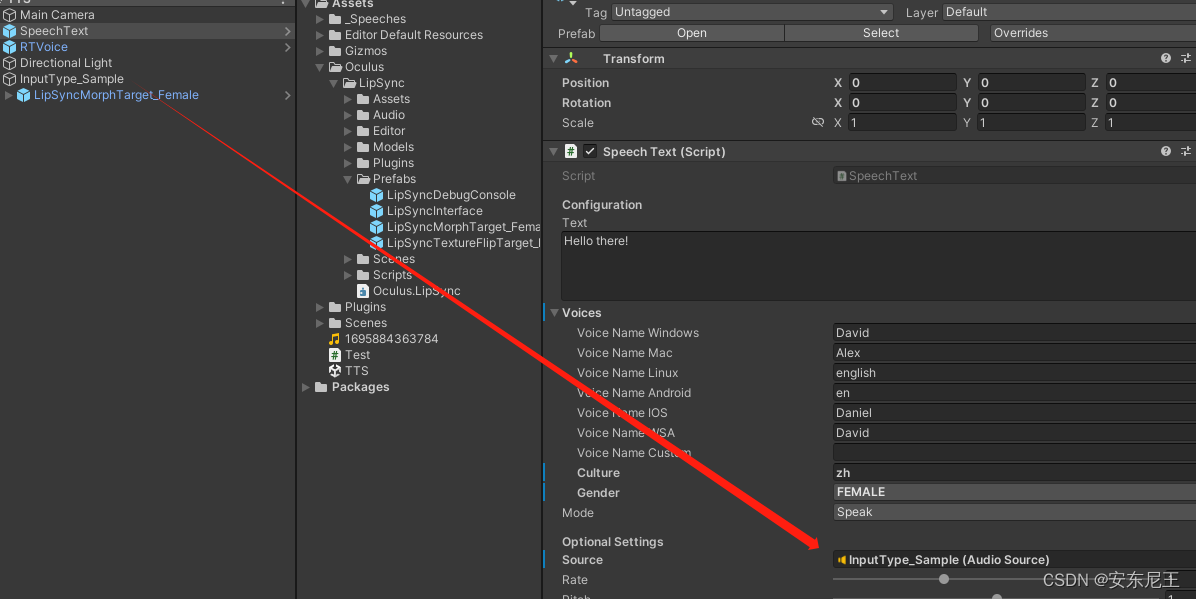

2、组件配置

详细介绍如何配置OVRLipSync插件,包括将示例工程中的模型拖入场景,创建AudioSource组件并添加LipSync组件,将AudioSource组件给到SpeechText组件中的AudioSource属性,以及运行测试等步骤。

只是一个文字转语音后使用人物模型进行口型同步的Demo,如果要应用到具体项目中,还需要根据示例模型的Blendshap类型进行建模绑定,同步效果与表情变形器绑定的细腻程度有很大关系,通过合理配置和使用这些插件,可以实现更加真实、自然的人物口型同步效果,提升用户体验。

还没有评论,来说两句吧...