摘要:通过集成SwanLab,Transformers实现了AI训练的可视化监控。这一集成提供了一种强大的工具,能够实时监控和跟踪AI训练过程,从而提高效率和准确性。SwanLab的可视化功能使得训练过程中的数据更加直观,便于分析和调整。这一创新结合,有助于研究人员和开发人员更好地理解模型性能,优化训练过程,加速AI技术的发展和应用。

Hugging Face的Transformers是一个非常流行的开源库,提供了大量预训练的模型,主要用于自然语言处理(NLP)任务,这个库的目标是让最新的NLP模型易于使用,并支持多种框架,如TensorFlow和PyTorch,通过使用Transformers,你可以快速进行模型训练,并结合SwanLab进行实验跟踪与可视化。

SwanLabCallback介绍及使用方法

1、引入SwanLabCallback:

from swanlab.integration.huggingface import SwanLabCallback

SwanLabCallback是适配于Transformers的日志记录类,用于记录实验信息。

SwanLabCallback可以定义的参数包括:

project、experiment_name、description等,用于SwanLab项目的初始化。

也可以先在外部通过swanlab.init创建项目,然后集成会将实验记录到已创建的项目中。

2、传入Trainer:

在使用Transformers的Trainer时,可以通过callbacks参数将SwanLabCallback传入,以便进行实验的跟踪和记录。

swanlab_callback = SwanLabCallback(project="hf-visualization")

trainer = Trainer(

...

callbacks=[swanlab_callback],

)

trainer.train()3、完整案例代码:

以下是一个完整的案例代码,展示了如何使用SwanLabCallback与Hugging Face Transformers进行模型训练,代码中包括数据加载、模型定义、训练参数设置以及模型的训练过程,通过SwanLabCallback记录实验信息。

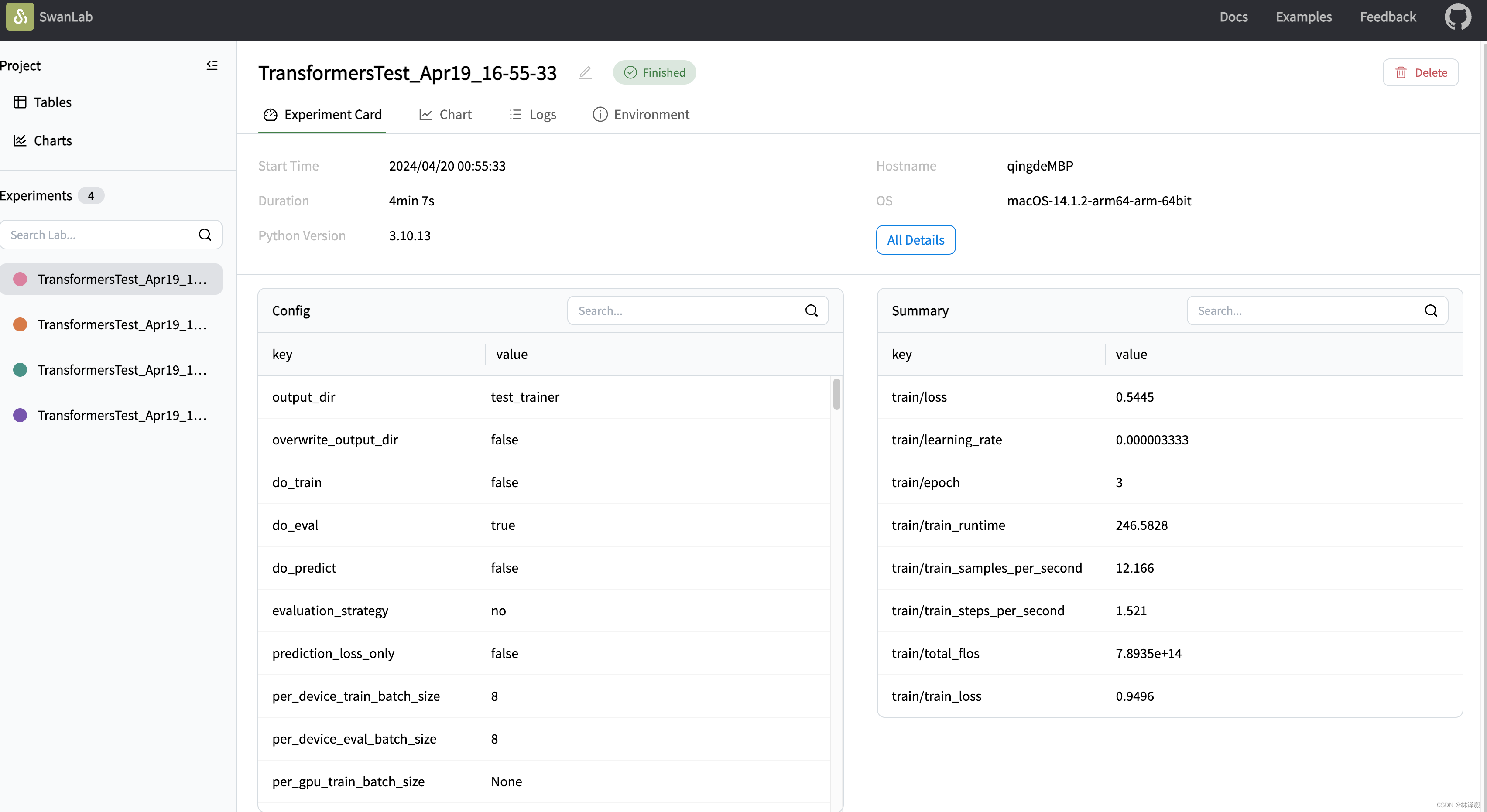

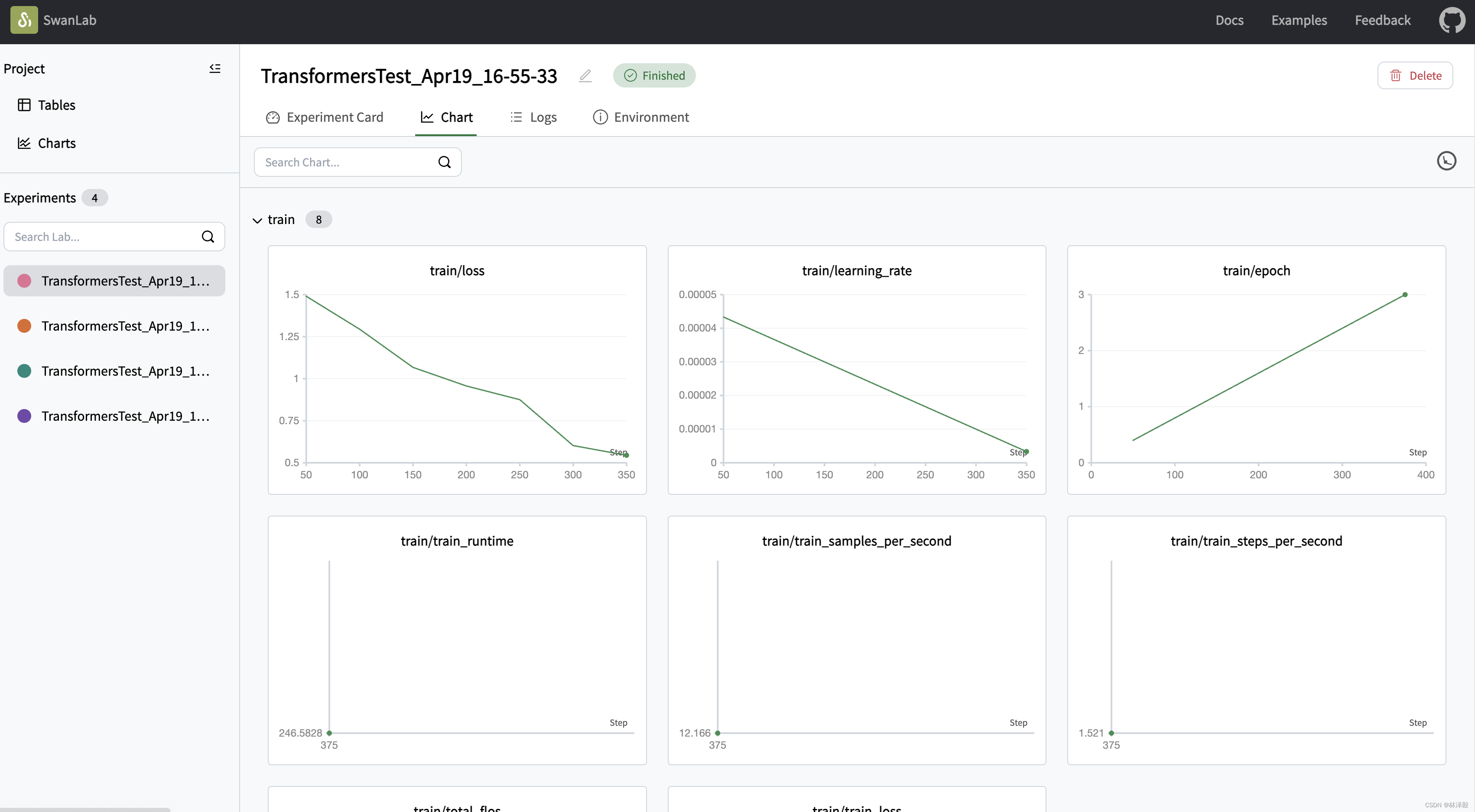

在代码的最后,提供了两张关于SwanLab实验跟踪与可视化的图片,展示了实验记录和结果展示的效果,通过SwanLab,你可以方便地跟踪实验过程,并可视化实验结果,这对于模型开发和调优非常有帮助。

为了运行此代码,你需要确保已经安装了必要的库,并正确配置了SwanLab和Hugging Face的环境,根据你的实际需求和数据集,可能需要调整代码中的某些部分。

还没有评论,来说两句吧...