温馨提示:这篇文章已超过411天没有更新,请注意相关的内容是否还可用!

摘要:本文介绍了深度学习框架PyTorch中的Tensor维度变换。文章将详细讲解如何通过PyTorch实现Tensor的维度变换,包括扩展、压缩、重塑等操作。文章将不断更新,提供更多关于Tensor维度变换的方法和技巧。通过阅读本文,读者可以更好地理解和运用Tensor维度变换,提高深度学习模型的性能。

`view()` 函数的补充说明

view() 函数在 PyTorch 中用于改变张量的视图而不改变其底层数据,当使用view() 时,必须确保新的视图与原张量的元素总数相同,否则会引发错误,这是因为view() 只是改变了张量的表示方式,底层数据并没有发生变化,所以元素总数必须一致。

二、关于unsqueeze() 和expand() 的补充说明

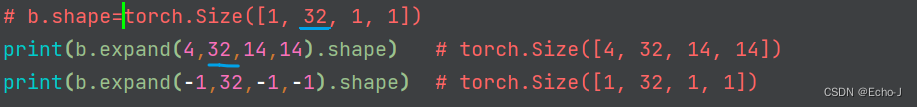

unsqueeze() 和expand() 都是在增加张量的维度,但它们的行为有所不同。unsqueeze() 会在指定的维度上增加一个新的维度,而expand() 会在所有维度上都增加新的维度(只有在大小为1的维度上才能扩展),在使用这两个函数时需要注意它们之间的差异。

三、关于transpose() 和permute() 的补充说明

transpose() 和permute() 都可以改变张量的维度顺序,但它们有一些不同。transpose() 只能交换两个维度,而permute() 可以任意地重新排列维度,这使得permute() 在某些情况下更加灵活和方便。

关于代码演示的修正

在您的代码演示中,有一些小错误需要修正,在expand() 的代码演示中,应该确保所有维度的大小都匹配,否则会出现错误,在转置部分的代码演示中,contiguous() 方法用于确保数据连续存储,这在某些情况下是必要的,在使用这些方法时,需要注意它们的正确用法和条件。

关于数据维度顺序和存储顺序的说明

在PyTorch中,数据维度顺序和存储顺序确实需要保持一致,这是因为张量的维度顺序决定了数据的布局方式,而存储顺序则决定了数据在内存中的布局,如果不一致,可能会导致数据处理错误或性能下降,在使用PyTorch进行数据处理时,需要注意保持数据维度顺序和存储顺序的一致性。

您的文章已经涵盖了PyTorch中关于张量维度操作的主要内容,通过补充和修正以上内容,可以使读者更深入地理解这些函数的使用方法和注意事项。

还没有评论,来说两句吧...